Google 문서도구에 글을 쓸 때 AI 지원을 받으려면 //을 입력하세요.

입력 // 매력적인 이메일과 맞춤 답변을 작성하세요.

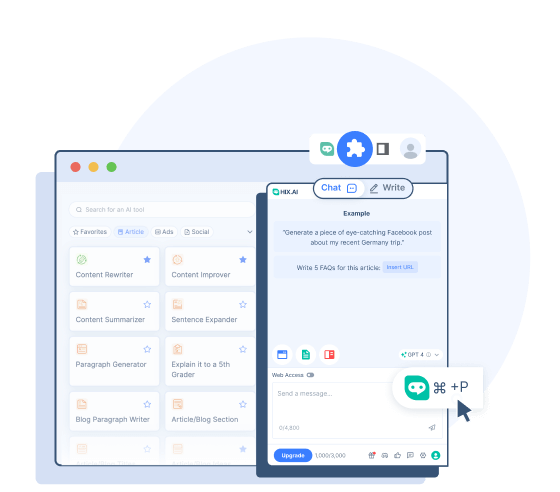

Chrome을 위한 더욱 강력한 Bing 사이드바 대안을 살펴보세요.

대표적인 검색결과 중에서 HIX.AI의 종합적인 답변을 찾아보세요.

번역, 재작성, 요약 등을 수행하려면 온라인에서 텍스트를 선택하세요.

- HIX Chat(ChatGPT 대안)

최신 정보로 대응할 수 있는 선도적인 AI 챗봇입니다.

- HIX Chat(로그인 없음)

HIX Chat에 대한 무제한 액세스를 경험해 보세요. 로그인이 필요하지 않습니다.

- GPT-4o(로그인 없음)

제한이 적고 연결이 더 원활한 GPT-4o의 고급 기능을 사용해 보세요.

- ChatGPT(로그인 없음)

로그인 없이 ChatGPT를 무료로 사용해보세요!

- GPT-4 온라인 채팅

온라인에서 GPT-4 챗봇을 무료로 사용해 보세요.

- 수학 AI 해결사

수학 숙제 문제에 대한 단계별 솔루션을 얻으세요.

GPT-4o: OpenAI 언어 모델의 차세대 진화

GPT-4o("o"는 "omni"를 의미)는 OpenAI에서 개발하고 2024년 5월 13일에 출시된 최첨단 다중 모드 대형 언어 모델입니다. 이는 GPT 모델 제품군의 성공을 기반으로 하며 다음을 도입합니다. 다양한 양식에 걸쳐 콘텐츠를 포괄적으로 이해하고 생성하는 데 있어 몇 가지 발전이 이루어졌습니다.

GPT-4o는 이전 모델에 비해 더 나은 자연어 처리 기능과 더 빠른 응답 시간을 제공합니다. 텍스트, 이미지, 오디오를 기본적으로 이해하고 생성하여 보다 직관적이고 대화형 사용자 경험을 가능하게 합니다. 이를 통해 GPT-4o는 지식 기반 질문에 답하고 텍스트를 생성할 뿐만 아니라 이미지와 비디오를 분석하고 설명하는 향상된 능력을 갖게 됩니다.

GPT-4o의 기능

OpenAI가 이 모델에 가져온 새로운 개선 사항은 오디오, 비전 및 텍스트 기능을 향상시킵니다.

다중 모드 입력 및 출력

GPT4-o의 각 입력 및 출력은 텍스트, 오디오 및 이미지의 조합이 될 수 있습니다. OpenAI의 이전 모델과 달리 모든 텍스트, 오디오 및 이미지는 변환 없이 처리됩니다(GPT-4o는 이미지를 읽고 오디오를 듣고 직접 출력할 수 있습니다). 이를 통해 GPT-4o는 항목을 더 빠르게 처리하고 이러한 항목을 더 잘 이해할 수 있습니다.

실시간 자연스러운 대화

GPT-4o의 향상된 음성 인식 및 응답 기능을 통해 눈에 띄는 지연 없이 음성 대화(다른 언어로도)에 참여할 수 있습니다. 모델은 화자의 말투와 감정을 관찰하고 적절한 응답을 전달할 수 있습니다. 또한 자연스러운 목소리와 감정적인 뉘앙스로 말할 수 있어 더욱 민감한 커뮤니케이션이 가능합니다.

시각적 콘텐츠 분석 및 편집

GPT-4o는 시각적 콘텐츠를 더 잘 이해하고 편집할 수 있습니다. 이미지의 그래픽, 텍스트 또는 데이터를 읽고 그 뒤에 숨겨진 의미를 이해할 수 있습니다. 분석용 이미지를 업로드하여 보다 정확한 통찰력과 설명을 얻을 수 있습니다. 모델은 또한 고객이 요청한 대로 고품질의 이미지를 정확하게 생성하거나 편집할 수 있습니다.

기억과 상황 인식

GPT-4의 업그레이드된 상황 창은 더 긴 대화에서도 상황을 유지할 수 있도록 보장합니다. 최대 128,000개의 토큰을 지원하여 상세한 분석과 일관된 대화가 가능합니다.

GPT-4o vs GPT-4 vs GPT-3.5

GPT-4o가 GPT-4 및 GPT-3.5와 어떻게 다른지 알고 싶으십니까? 주요 차이점은 다음과 같습니다.

GPT-4o

- GPT-4o는 2024년 5월에 처음 출시되었습니다.

- 오디오 및 비디오 입력에 응답하기 위해 더 빠른 속도와 더 낮은 대기 시간을 갖춘 고급 다중 모드 모델입니다.

- GPT-4o는 2023년 10월까지의 데이터로 훈련되었습니다.

- GPT-4o는 추론, 음성 인식 및 시각적 기능 벤치마크에서 더 나은 성능을 발휘합니다.

- 영어가 아닌 언어의 텍스트 처리가 크게 향상되었습니다.

GPT-4

- GPT-4는 2023년 3월에 처음 출시되었습니다.

- 이는 다중 모드 모델입니다. 즉, 텍스트 프롬프트와 함께 이미지 및 음성 입력을 이해할 수 있습니다.

- GPT-4는 2023년 12월까지의 최신 데이터로 학습되었습니다.

- GPT-4는 코딩, 쓰기, 추론, 허용되지 않는 콘텐츠 방지 등의 영역에서 GPT-3.5보다 성능이 뛰어납니다.

- GPT-4는 더 안정적이고 창의적이며 벤치마크에서 GPT-3.5보다 더 나은 점수를 받았습니다.

GPT-3.5

- GPT-3.5는 2022년 11월에 출시되었습니다. 이는 ChatGPT 무료 버전을 지원합니다.

- GPT-3.5는 텍스트 입력 및 출력으로 제한됩니다.

- 2021년 9월까지의 이전 데이터에 대해 학습되었습니다.

- GPT-3.5는 응답을 생성할 때 신뢰성과 창의성이 떨어지는 경우가 있습니다.

GPT-4o에 액세스하는 방법

GPT-4o는 출시 이후 액세스가 가능해졌습니다. 그 힘에 접근하고 경험할 수 있는 방법은 여러 가지가 있습니다.

ChatGPT에서 GPT-4o 사용

OpenAI를 통해 ChatGPT 사용자는 이 새로운 모델을 챗봇에서 바로 사용할 수 있습니다. 무료 사용자는 메시지 제한을 통해 액세스할 수 있으며 텍스트로만 이 모델과 상호 작용할 수 있습니다. 유료 ChatGPT Plus 사용자의 경우 이러한 제한이 모두 해제됩니다.

OpenAI API와 함께 GPT-4o 사용

OpenAI는 또한 GPT-4o를 API 액세스를 위한 모델 옵션으로 사용할 수 있도록 했습니다. 이제 개발자는 GPT-4o 기능을 프로젝트나 애플리케이션에 통합할 수 있습니다.

HIX.AI에서 GPT-4o 사용

GPT-4o에 보다 편리하게 액세스할 수 있는 방법이 필요하다면 HIX.AI에서 시도해 볼 수 있습니다. 로그인하지 않고도 무료로 사용해 볼 수 있습니다. 공식적인 방법을 통해 GPT-4o에 액세스하는 것이 제한된 경우 이는 이 혁신적인 모델을 사용할 수 있는 또 다른 신뢰할 수 있는 방법입니다.

HIX.AI에서 GPT-4o를 사용하는 이유

HIX.AI에서 GPT-4o에 액세스하면 다음과 같은 몇 가지 이점이 있습니다.

로그인이 필요하지 않습니다

HIX.AI로 즉각적인 접속의 편리함을 경험해보세요. GPT-4o 페이지로 이동하면 바로 GPT-4o와 상호작용을 시작할 수 있습니다.

더욱 원활한 연결

HIX.AI에서 GPT-4o에 액세스할 때 서버 문제가 발생할 가능성이 적습니다. 우리는 이 모델에 대한 연결을 위해 대기 시간을 최소화하고 고성능을 유지하기 위해 노력하고 있습니다.

무제한 액세스

우리는 GPT-4o 챗봇 액세스에 어떠한 제한도 두지 않습니다. 언제 어디서나 이 강력한 AI 혁신을 자유롭게 경험해 보세요.

GPT-4 및 ChatGPT에 대한 추가 리소스를 찾아보세요

여기에서 유익한 기사를 통해 가장 발전된 언어 모델에 대해 자세히 알아보세요.

채팅 GPT로 수익을 창출하는 방법은 무엇입니까?

Chat GPT로 수익을 창출하는 방법에 대해 생각해 본 적이 있나요? Chat GPT를 사용하여 수익을 창출하는 방법에 대한 포괄적인 가이드를 준비했습니다.

10가지 최고의 ChatGPT 앱

모바일 장치용 상위 10개 ChatGPT 앱을 찾아보세요. 최고의 앱으로 AI 경험을 향상하세요.

최고의 채팅 GPT 감지기 및 ChatGPT 검사기

이 문서에서는 필요에 따라 올바른 Chat GPT 검사기를 선택하는 데 도움이 되는 최고의 ChatGPT 탐지기 도구 9가지와 해당 도구의 장단점을 다룹니다.

ChatGPT Discord Bot: 단계별 가이드

ChatGPT Discord 챗봇으로 활용하는 데 관심이 있으신가요? 전문가처럼 ChatGPT Discord 봇을 추가하고 사용하는 방법은 다음과 같습니다.

ChatGPT 에 투자하는 방법

ChatGPT 기술에 관심이 있고 Chat GPT에 투자하는 방법을 알고 싶으십니까? Chat GPT 주식을 구매하는 방법을 알아보려면 계속 읽어보세요.

GPT-3과 GPT-4 : 차이점은 무엇입니까?

GPT-4 와 GPT-3 매개변수 및 기능 비교: 어떤 모델이 더 우수하며, GPT의 미래에서 무엇을 기대할 수 있습니까?

자주 묻는 질문

GPT-4o는 이전 모델보다 어떻게 성능이 뛰어납니까?

이전 모델에 비해 GPT-4o의 주요 장점은 향상된 멀티모달 기능으로, 이를 통해 실시간 대화와 고급 비전/오디오 처리를 낮은 지연 시간으로 수행할 수 있습니다.

GPT-4o가 언어 번역에 도움을 줄 수 있나요?

예. GPT-4o는 더 나은 다국어 기능을 제공하며 50개 이상의 언어에 대한 훌륭한 번역기 역할을 할 수 있습니다.

GPT-4o에 대한 지식 마감일은 언제입니까?

지식 마감일, 즉 GPT-4o가 훈련받은 최신 정보는 2023년 10월입니다.

GPT-4o에는 제한이 있나요?

그 기능에도 불구하고 GPT-4o는 여전히 잠재적 편견, 환각, 강력한 장기 기억 부족과 같은 대규모 언어 모델에서 물려받은 한계를 가지고 있습니다. 또한 지식은 기본적으로 훈련 데이터로 제한됩니다.