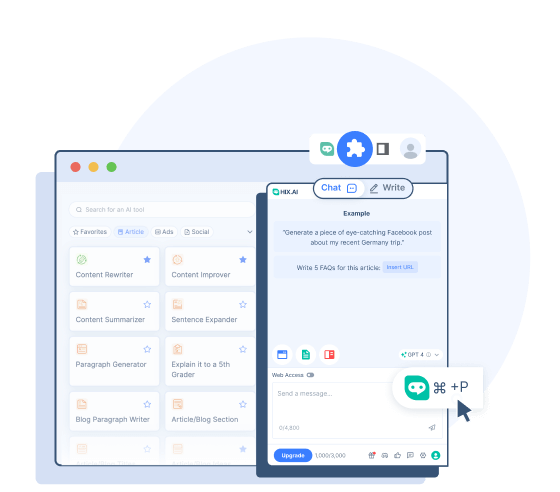

HIX Writer

Uzyskaj dostęp do ponad 120 narzędzi do pisania opartych na sztucznej inteligencji, aby poprawić swoje wrażenia z pisania.

Sprawdź moduł zapisujący HIX

BrowserGPT

Poznaj najpotężniejszego, wszechstronnego asystenta ChatGPT w Internecie.

Sprawdź BrowserGPT

Wpisz //, aby korzystać z pomocy AI podczas pisania w Dokumentach Google.

Wpisz // twórz atrakcyjne e-maile i spersonalizowane odpowiedzi.

Poznaj potężniejszą alternatywę dla paska bocznego Bing dla przeglądarki Chrome.

Znajdź kompleksowe odpowiedzi HIXAI wśród typowych wyników wyszukiwania.

Wybierz dowolny tekst online, aby go przetłumaczyć, przepisać, podsumować itp.

Wpisz //, aby utworzyć zwięzły, ale mocny wpis Twitter dotyczący tego trendu.

Wpisz //, aby utworzyć atrakcyjne podpisy do swoich postów na Instagramie.

Wpisz //, aby przygotować interaktywne posty Facebook, które zaangażują Twoją społeczność.

Wpisz //, aby podać wartościowe, przegłosowane odpowiedzi w serwisie Quora.

Wpisz //, aby utworzyć posty Reddit, które będą odpowiadać konkretnym społecznościom.

Podsumuj długie filmy z YouTube jednym kliknięciem.

- HIX Chat (alternatywa dla ChatGPT)

Wiodący chatbot AI, który może odpowiadać aktualnymi informacjami.

- HIX Chat (bez logowania)

Doświadcz nieograniczonego dostępu do HIX Chat. Nie jest potrzebne logowanie.

- GPT-4o (bez logowania)

Wypróbuj zaawansowaną moc GPT-4o z mniejszymi ograniczeniami i płynniejszym połączeniem.

- CzatGPT (bez logowania)

Korzystaj z ChatGPT za darmo bez logowania!

- GPT-4 Czat online

Skorzystaj z darmowego chatbota GPT-4 online.

- Rozwiązanie matematyczne AI

Uzyskaj szczegółowe rozwiązania każdego zadania domowego z matematyki.

GPT-4o

- Historia

GPT-4o: Następna ewolucja modeli językowych OpenAI

GPT-4o („o” oznacza „omni”) to najnowocześniejszy wielomodalny model wielkojęzykowy opracowany przez OpenAI i wydany 13 maja 2024 r. Opiera się na sukcesie rodziny modeli GPT i wprowadza kilka postępów w kompleksowym rozumieniu i generowaniu treści w różnych modalnościach.

GPT-4o oferuje lepsze możliwości przetwarzania języka naturalnego i szybszy czas reakcji w porównaniu do poprzednich modeli. Może natywnie rozumieć i generować tekst, obrazy i dźwięk, zapewniając bardziej intuicyjne i interaktywne doświadczenia użytkownika. Dzięki temu GPT-4o może nie tylko odpowiadać na pytania oparte na wiedzy i tworzyć tekst, ale także analizować i opisywać obrazy i filmy.

Możliwości GPT-4o

Nowe ulepszenia wprowadzone przez OpenAI do tego modelu podnoszą jego możliwości w zakresie dźwięku, obrazu i tekstu.

Multimodalne wejście i wyjście

Każde wejście i wyjście GPT4-o może być dowolną kombinacją tekstu, dźwięku i obrazów. W przeciwieństwie do poprzednich modeli OpenAI, cały tekst, dźwięk i obrazy są przetwarzane bez jakiejkolwiek konwersji (GPT-4o może czytać obrazy, słyszeć dźwięk i bezpośrednio je wysyłać). Dzięki temu GPT-4o może je szybciej przetwarzać i lepiej rozumieć te elementy.

Naturalne rozmowy w czasie rzeczywistym

Ulepszone możliwości rozpoznawania głosu i reagowania GPT-4o umożliwiają mu prowadzenie rozmów werbalnych (nawet w różnych językach) bez zauważalnych opóźnień. Model może obserwować ton i emocje mówiących i udzielać odpowiednich odpowiedzi. Potrafi także mówić naturalnym głosem i z niuansami emocjonalnymi, umożliwiając bardziej wrażliwą komunikację.

Analiza i edycja treści wizualnych

GPT-4o może lepiej rozumieć i edytować treści wizualne. Potrafi odczytać grafikę, tekst lub dane na obrazach i zrozumieć ich znaczenia. Możesz przesyłać obrazy do analizy, uzyskując bardziej precyzyjne spostrzeżenia i wyjaśnienia. Model może również tworzyć lub edytować obrazy dokładnie zgodnie z Twoimi żądaniami, o wysokiej jakości.

Pamięć i świadomość kontekstowa

Ulepszone okno kontekstowe GPT-4 zapewnia utrzymanie kontekstu podczas dłuższych rozmów. Obsługuje do 128 000 tokenów, umożliwiając szczegółową analizę i spójne rozmowy.

GPT-4o vs GPT-4 vs GPT-3.5

Chcesz wiedzieć, czym GPT-4o różni się od GPT-4 i GPT-3.5? Oto ich kluczowe różnice:

GPT-4o

- GPT-4o został pierwotnie wydany w maju 2024 r.

- Jest to bardziej zaawansowany model multimodalny charakteryzujący się większą szybkością i mniejszymi opóźnieniami w reagowaniu na wejścia audio i wideo.

- GPT-4o jest szkolony na danych do października 2023 r.

- GPT-4o radzi sobie lepiej w testach rozumowania, rozpoznawania mowy i możliwości wizualnych.

- Ma znaczną poprawę w przetwarzaniu tekstu w językach innych niż angielski.

GPT-4

- GPT-4 został pierwotnie wydany w marcu 2023 r.

- Jest to model multimodalny, co oznacza, że rozpoznaje komunikaty obrazowe i głosowe oraz komunikaty tekstowe.

- GPT-4 jest szkolony w oparciu o bardziej aktualne dane do grudnia 2023 r.

- GPT-4 działa lepiej niż GPT-3.5 w obszarach takich jak kodowanie, pisanie, rozumowanie i unikanie niedozwolonych treści.

- GPT-4 jest bardziej niezawodny i kreatywny oraz ma lepsze wyniki w testach porównawczych niż GPT-3.5.

GPT-3.5

- GPT-3.5 został wydany w listopadzie 2022 roku. Obsługuje bezpłatną wersję ChatGPT.

- GPT-3.5 ogranicza się do wprowadzania i wyprowadzania tekstu.

- Jest szkolony na starszych danych do września 2021 r.

- GPT-3.5 może czasami być mniej niezawodny i kreatywny podczas generowania odpowiedzi.

Jak uzyskać dostęp do GPT-4o

GPT-4o jest dostępny od chwili jego wydania. Istnieje kilka sposobów, aby uzyskać dostęp do jego mocy i doświadczyć jej mocy:

Użyj GPT-4o na ChatGPT

OpenAI umożliwiło użytkownikom ChatGPT korzystanie z tego nowego modelu bezpośrednio w chatbocie. Bezpłatni użytkownicy będą mieli dostęp z ograniczeniem wiadomości i będą mogli wchodzić w interakcję z tym modelem tylko za pomocą tekstu. W przypadku płatnych użytkowników ChatGPT Plus wszystkie te ograniczenia zostają zniesione.

Użyj GPT-4o z API OpenAI

OpenAI udostępniło również GPT-4o jako modelową opcję dostępu API. Programiści mogą teraz zintegrować moc GPT-4o ze swoim projektem lub aplikacją.

Użyj GPT-4o na HIX.AI

Jeśli potrzebujesz wygodniejszego sposobu dostępu do GPT-4o, możesz wypróbować go na HIX.AI. Wypróbowanie jest bezpłatne, bez konieczności logowania się. Jeśli nie możesz uzyskać dostępu do GPT-4o za pomocą oficjalnych metod, jest to kolejny niezawodny sposób wykorzystania tego innowacyjnego modelu.

Dlaczego warto używać GPT-4o na HIX.AI

Dostęp do GPT-4o na HIX.AI wiąże się z kilkoma korzyściami:

Nie wymaga logowania

Poczuj wygodę natychmiastowego dostępu dzięki HIX.AI. Po prostu przejdź do naszej strony GPT-4o i od razu możesz rozpocząć interakcję z GPT-4o.

Płynniejsze połączenie

Podczas uzyskiwania dostępu do GPT-4o na HIX.AI ryzyko wystąpienia problemów z serwerem jest mniejsze. Staramy się minimalizować opóźnienia i utrzymywać wysoką wydajność połączenia z tym modelem.

Nieograniczony dostęp

Nie nakładamy żadnych ograniczeń na dostęp do naszego chatbota GPT-4o. Gdziekolwiek i kiedykolwiek jesteś, możesz swobodnie korzystać z tej potężnej innowacji AI.

Odkryj więcej zasobów na temat GPT-4 i ChatGPT

Dowiedz się więcej o najbardziej zaawansowanych modelach językowych dzięki naszym artykułom informacyjnym tutaj:

Najlepsze detektory Chat GPT i narzędzia sprawdzające ChatGPT

W tym artykule omówiono 9 najlepszych narzędzi do wykrywania ChatGPT , wraz z ich zaletami i wadami, które pomogą Ci wybrać odpowiedni moduł sprawdzania Chat GPT zgodnie z Twoimi potrzebami.

Logowanie GPT-4 : Jak zalogować się do ChatGPT za darmo

ChatGPT -4 to najnowsza wersja popularnego chatbota, jednak korzystanie z niego ma swoją cenę. Czytaj dalej, aby dowiedzieć się, jak zalogować się i korzystać z ChatGPT -4 za darmo.

GPT-3 vs. GPT-4 : Jakie są różnice?

Badanie parametrów i możliwości GPT-4 i GPT-3: który model jest lepszy i czego możemy się spodziewać po przyszłości GPT?

Jak korzystać ChatGPT w Arabii Saudyjskiej?

Dowiedz się, jak korzystać z ChatGPT w Arabii Saudyjskiej i jak odblokować witryny w Arabii Saudyjskiej za pomocą HIX Chat .

Jak inwestować w ChatGPT

Interesuje Cię technologia ChatGPT i chcesz wiedzieć jak inwestować w Chat GPT? Czytaj dalej, aby dowiedzieć się, jak kupić akcje Chat GPT.

Czy nauczyciele mogą wykryć ChatGPT ?

Dowiedz się, czy nauczyciele potrafią wykryć użycie ChatGPT i poznaj alternatywy, takie jak HIX.AI , które mogą uniknąć wykrycia.

Często zadawane pytania

W czym GPT-4o przewyższa poprzednie modele?

Głównymi zaletami GPT-4o w porównaniu z poprzednimi modelami są ulepszone możliwości multimodalne, które umożliwiają prowadzenie rozmów w czasie rzeczywistym oraz zaawansowaną obsługę obrazu/dźwięku przy niższych opóźnieniach.

Czy GPT-4o może mi pomóc w tłumaczeniu języków?

Tak. GPT-4o ma lepsze możliwości wielojęzyczne i może działać jako dobry tłumacz dla ponad 50 języków.

Jaka jest data graniczna wiedzy dla GPT-4o?

Datą graniczną wiedzy, czyli najnowszymi informacjami, na podstawie których GPT-4o był szkolony, jest październik 2023 roku.

Czy GPT-4o ma jakieś ograniczenia?

Pomimo swoich możliwości, GPT-4o nadal ma ograniczenia odziedziczone po dużych modelach językowych, takie jak potencjalne uprzedzenia, halucynacje i brak solidnej pamięci długoterminowej. Jego wiedza jest również zasadniczo ograniczona do danych szkoleniowych.